AI gaat veel verder dan tools als ChatGPT zegt Jan van den Berg FG bij de HvA

Als Functionaris Gegevensbescherming (FG) op een grote onderwijsinstelling heb je te maken met grote vraagstukken en bestuurlijke kwesties die raken aan privacy en essentiële gegevensbescherming. Jan van den Berg vertelt over zijn werk als FG op de Hogeschool van Amsterdam (HvA), geeft zijn visie en gaat in op de opmars van AI. ‘Wat mij betreft moet je kunstmatige intelligentie altijd in een breder en ethisch perspectief zien: het gaat veel verder dan alleen generatieve AI.’

Stevig in de schoenen

Stevig in je schoenen staan, goed kunnen communiceren en goed begrijpen waar een wet over gaat en de bedoeling daarvan ook duidelijk kunnen maken aan mensen zonder juridische achtergrond. Dat zijn volgens Jan van den Berg de belangrijkste eigenschappen die de rol van een Functionaris Gegevensbescherming tot een succes maken. Hij doet alles met de zachte hand: mensen met argumenten overtuigen om het juiste te doen: ‘Ik heb als FG geen sanctiemogelijkheden tot mijn beschikking, dus het moet op een andere manier.’

Wat doet een FG?

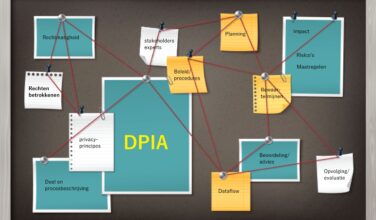

Van den Berg is sinds 2022 FG van de Hogeschool van Amsterdam, een onderwijsinstelling met ruim 45.000 studenten. Er is, vooral bij de buitenwacht nog wel eens onduidelijkheid over wat een FG precies doet. Maakt hij nou wel of geen onderdeel uit het van het interne privacyteam? Dat is inderdaad nog wel eens lastig uit te leggen, beaamt Van de Berg in een persoonlijk gesprek, uitkijkend over de Amsterdamse Amstelbuurt. Het eenvoudige antwoord is, zo zegt hij: 'Intern toezicht houden, onderbouwd advies geven en ervoor zorgen dat de gemaakte afspraken, ook bestuursniveau, worden nageleefd.' Tegelijkertijd is dat maar één kant van wat hij doet. ‘Mijn drijfveer is ervoor te zorgen dat bij alle keuzes die worden gemaakt binnen de besluitvorming over persoonsgegevens de betrokkenen altijd op het netvlies blijven staan.’

Uitdaging

Dat hele pakket vormt een behoorlijke uitdaging, aldus Van den Berg. ‘Er zitten veel complexe organisatorische elementen aan vast. Plus dat je ook afhankelijk bent van externe factoren, zoals bezuinigingen, die ook weer gevolgen kunnen hebben voor de privacydomein’. En soms is er sprake van onenigheid, over de koers bijvoorbeeld. ‘Maar ja, zonder wrijving geen glans, zeg ik altijd maar. Maar je moet er wel altijd voor zorgen dat je met elkaar in dezelfde film zit, en in goede harmonie aan het werk blijft. Ik wil geen politieagent zijn. Want alleen samen kun je tot oplossingen komen.’

AI, ethiek en verantwoorde digitalisering

De HvA is een grote onderwijsinstelling, die samenwerkt met de Universiteit van Amsterdam. En dus komen er veel digitale uitdagingen op de Hogeschool af. Het zal voor menigeen bekend in de oren klinken: het gevaar van datalekken, het risico op cybercrime- en aanvallen en de onvermijdelijke opmars van Artificial Intelligence (AI), met alle kansen die AI ook heeft voor het onderwijs. Generatieve AI, met tools als ChatGPT, is zo’n uitdaging. Volgens Van den Berg is het de realiteit: studenten gebruiken het volop en dat is ook goed. Want, zo zegt hij, het levert ook weer innovatie en vernieuwing op. De HvA moet, als onderwijsinstelling, de impact van het gebruik van AI en algoritmen breder zien dan alleen de gevolgen van GenAI, vindt hij. En dan heeft hij het vooral over ethiek. 'Daarvan zijn we ons heel erg bewust. We hebben bij de HvA een mooi platform, geheten de Ambitietafel Verantwoorde Digitalisering. De komst van AI levert vraagstukken op die daar enorm aan raken en die we dan ook uitgebreid met elkaar bespreken: hoe ga je daarmee om?’

AI Ethiek-pilot

De HvA deed in 2024 mee aan de SURF AI Ethiek-pilot. Van den Berg: ‘Ik vond het een heel mooie manier om samen te werken: hoe moeten we, als onderwijsinstellingen, gestructureerd omgaan met ethische vraagstukken als gevolg van de inzet van AI? En dan is het er nog het volwassenheidsmodel voor AI-ethiek van SURF dat vorig jaar als pilot het levenslicht zag. Het is een model dat instellingen ondersteunt bij het maken van ethische keuzes en helpt deze keuzes te verankeren in hun strategieën. Een aantal mensen heeft het model eerst zelf ingevuld. Vervolgens hebben we besloten om een expertgroep te formeren, want er zijn natuurlijk heel veel mensen in de organisatie die al met AI te maken hebben,’ aldus Van den Berg. ‘Daarna hebben we, vanuit de Ambitietafel Verantwoorde Digitalisering, een plenaire werksessie geprogrammeerd met als onderwerp “Artificiële Intelligentie (AI) en algoritmes in onderwijs, onderzoek en bedrijfsvoering binnen de HvA”’ Zo’n tachtig mensen zaten aan tafel die vanuit hun eigen werkterrein ervaringen met AI deelden, vertelt de FG. ‘Centraal stond daarin de vraag: wat is de impact van AI op de waardeketens van de HvA als onderwijsinstelling? En wat betekent het voor onze governance en manier van werken – dat soort vragen kwamen allemaal aan bod.’

Het waarom van AI

Voor hem staat telkens één uitgangspunt voorop: het ‘waarom’ van zaken die aan privacy en AI gerelateerd zijn en de centrale rol van de mens. ‘Ik probeer door de regels van de wet heen te kijken. Een wet komt namelijk voort uit een gemeenschappelijke waarde die ons verbindt. Van daaruit kan een gesprek starten. Zeker nu de AI Act eraan zit te komen. Waarom doen we dit met elkaar? AI biedt enorm veel kansen en als je die goed in kaart brengt, weet je ook waar de kwetsbaarheden zitten.’ Plus, zegt Van den Berg: ‘Je moet de mens altijd in de cockpit laten zitten. Wij hebben de regie over AI. Wij bepalen wat we ermee doen. Dat mogen we nooit uit het oog verliezen.’

Binnen het AI-dossier, maar ook daarbuiten, zijn zaken als de bescherming van (bijzondere) persoonsgegevens van het allergrootste belang, aldus de FG. ‘We hebben te maken met studenten en onderzoekers. Het is erg belangrijk dat zeer prudent met data wordt omgesprongen. Vooral ook bij de opslag en verwerking ervan.’ Hij maakt zich – eveneens in breder verband - zorgen over de geopolitiek die de HvA als het ware binnenwandelt. ‘Cyberdreiging vormt echt wel een bedreiging. De boel kan zo worden lamgelegd, bijvoorbeeld op het gebied van elektriciteit en dataverkeer. En dat zit je met een groot probleem.’

Je moet je data goed op orde hebben, zegt Van den Berg tot slot. ‘Als je de data goed hebt geclassificeerd en georganiseerd, en compliant met de AVG, wordt het veel makkelijker om met AI aan de slag te gaan. Zodat je ook goede AI-systemen kan gaan bouwen. En dan sla je meerdere vliegen in een klap, want je opereert ook binnen de AI Act.’

Jouw verhaal ook hier?

Het PEC is altijd op zoek naar privacyprofessionals die hun visie of aanpak binnen hun instelling willen delen. Interesse? Stuur een bericht naar pec@surf.nl.